ABC中文

Will Jackson

Posted Fri 31 May 2024

视频中的一名年轻亚洲男子留着短胡须,头顶金发,坐在一间凌乱卧室的游戏椅上。

在接下来的一分钟里,他的脸在十几种不同的性别和种族中变换。

这不仅是TikTok的又一款新滤镜。

该视频是在为一种实时深伪换脸系统做广告。据报道,该系统被东南亚犯罪集团用来进行所谓“杀猪盘”的网络诈骗活动。

专家称,这项技术和其他新的人工智能(AI)工具——如生成式人工智能聊天机器人——正在提高诈骗的有效性并扩大了新受害者的范围。

然而,与其他诈骗活动相比,一些诈骗活动在使用新技术方面似乎不太成功。

“杀猪盘”泛滥

自2020年以来,东南亚地区涌现出数十个呼叫中心式诈骗团伙,绝大多数由中国人控制。这些团伙主要分布在柬埔寨、缅甸和老挝等国。

他们的招牌是“杀猪盘”式的诈骗,即通过社交媒体或短信与受害者联系,结为朋友或引诱他们,然后诱骗他们参与虚假的投资计划,通常是加密货币。

这些犯罪集团最初主要雇用且迫害的大多数都是中国人,但据报道,在中国政府的打击下,这些犯罪集团越来越多地将目标对准不同国籍的人。

典型的犯罪团伙会在坐落在坚固院落中的一幢幢高大办公楼里运作,他们有通过信息应用程序与受害者聊天的“键盘手”,有充当骗局形象和声音的模特,还有管理业务的老板。

他们的扩散导致了诈骗活动的大规模激增,全球各地都有人因此家破人亡,财产损失总额高达数十亿澳元。

而据有关部门称,人工智能正在使他们的骗局更加有效。

今年早些时候,联合国毒品和犯罪问题办公室(UNODC)警告说,“基于大语言模型的聊天机器人、深伪技术和自动化方面的最新进展”使“更复杂、更具破坏性的网络诈骗”成为可能。”

该组织说:“通过使用人工智能来创建计算机生成的几乎与真人无异的图像和声音,骗子们可以利用人们的信任和情感,以惊人的成功率实施社交操纵诈骗。”

“非常、非常、非常扭曲的事情”

许多从事这些网络诈骗活动的人都是从其他国家被诱骗来的,他们先是被许诺会提供合法工作,然后就被迫在奴隶般的条件下工作。据报告,逃跑者遭到殴打和酷刑。

朱达·塔纳(Judah Tana)是总部位于泰国的非政府组织全球推进项目(Global Advance Projects)的负责人。该组织帮助了数百名从缅甸杀猪盘骗局中逃脱的人口贩运的受害者。

塔纳先生说,犯罪集团从“第一天起”就把人工智能的研发作为优先事项,并愿意不遗余力地获取最先进的技术。

他说,缅甸的一些诈骗团伙正在使用先进的换脸技术。

他对澳大利亚广播公司说:“这种技术并不是到处都有,但在一些较大的诈骗团伙中肯定有,而且他们一直在不断提高和改进。”

他说,他帮助过的人中就有一位计算机工程师,她唯一工作就是为该犯罪组织开发人工智能。

在访问缅甸北部一家咖啡店时,塔纳先生和他的相关合作伙伴在她尽管有保安人员的陪同还是设法溜走后向她提供了帮助,。

他说:“她说[他们的技术]比她在世界上见过的任何东西都要先进,比她研究过的任何东西都要先进。”

塔纳先生说,为了让这名妇女为他们干活,大院经理把一些人带到房间里,当着她的面殴打他们。

“这是一件非常、非常、非常扭曲的事情。但这并非个例,”他说。

技术飞速发展

深伪技术最初只能在拍摄完成后修改镜头,但近年来该技术得到了快速发展,现在已经可以令人信服地实时工作。

2022年,娱乐人工智能专业公司Metaphysic让深伪制成的西蒙·考威尔(Simon Cowell)在《美国达人秀》(America’s Got Talent)上现场对着西蒙·考威尔本人演唱,此举令观众惊叹不已。

吴明晓(Ngô Minh Hiếu )是一名越南前黑客和身份窃贼,后转为网络安全专家,他说,实时换脸技术——一种只改变主体脸部的深伪技术——现在可以很容易地通过开源软件或付费订阅免费获取。

全球反诈骗组织(GASO)指点澳大利亚广播公司浏览了加密信息平台Telegram上的换脸软件广告。

澳大利亚广播公司看到的一家提供商的中文广告吹嘘其“人工智能实时换脸”是“精准聊天”和“杀猪盘”的“必备软件”。

“它解决了好看的[真人]模特难以招聘和管理且成本高昂的问题,”该广告说。

该软件还集成了语音克隆功能,可以模仿“60%到95%”相似度的目标人物。

不过,广告警告说,它只能匹配声音的音色。

它说:“你需要弄清楚目标人物的说话节奏、说话习惯、语调、重音和卷舌音。”

另一家“换脸”软件供应商在柬埔寨提供全天候支持和“送货上门”服务,并声称已在1000多个院落安装了其产品。

同样是中文的该广告称,该系统只需要一张照片,就可以在WhatsApp、Messenger、Line等信息平台上进行视频通话。

广告称,“面部触摸不会影响真实感。”

“消除了其他软件中发现的可能意外暴露真实人脸的问题。”

吴先生还说,除了杀猪盘,犯罪分子还利用换脸技术进行其他类型的诈骗,如冒充名人进行投资诈骗,冒充家人或警察恐吓受害者给他们钱。

他说,这种技术还可以用来绕过一些金融机构要求的视频身份检查。

在澳大利亚,阳光海岸市市长罗珊娜·纳托利(Rosanna Natoli)最近报告说,一名骗子利用这种技术冒充她与她的一位朋友在Skype上通话。

“这位朋友告诉我说,这个人看起来像我,但听起来不像我,” 纳托利对ABC阳光海岸电台说。

真人更“正当”

虽然软件开发商声称这项技术可以让没有技术知识的“老板们”轻松使用,但熟悉这个行业的人告诉ABC,目前一些院落仍坚持更多使用模拟方法。

一位直接了解柬埔寨诈骗中心情况的消息人士向ABC证实,“人工智能模型”在那里被广泛使用。

但他表示,技术能力、计算能力和网络带宽等方面的限制往往制约了骗子们使用换脸 技术。

他说:“[在许多情况下]从东欧雇佣一个模特要实用得多。”

他说,尽管技术在进步,但真人上镜仍然更“正当”。

“最重要的是,大多数换脸应用程序无法伪造实时声音,”他说。

萨姆(Sam)是一名中国公民,直到最近他一直在WhatsApp上从事针对美国人和欧洲人的加密货币杀猪盘行动,他告诉ABC说,他的老板曾短暂尝试过人工智能。

在缅甸北部果敢地区工作时,充当行动“面孔”的越南模特逃跑了。

萨姆(Sam)要求使用化名,他说他所在团队的上司曾尝试使用一款应用程序,他们希望这款应用程序能在视频通话时用数字技术改变团队中一名讲英语成员的外貌。

他说,最后老板们没有足够的照片来让这个应用程序工作。

不久之后,他的团队被迫搬到了柬埔寨的西哈努克市,他说那里的诈骗公司大多使用的是俄罗斯和乌克兰的模特。

他说:“我在[西哈努克市]看到了很多这样的情况。”

获得聊天机器人的帮助

过去,杀猪盘的“键盘手”通常根据详细的“脚本”工作,试图获得受害者的信任。

据报,现在他们还利用人工智能大语言模型或聊天机器人,用其他语言向受害者发送信息。

虽然ChatGPT、Gemini和Copilot等主要人工智能聊天机器人都有防止其协助非法活动的防护栏,但其他大语言模型的开发却没有任何此类限制。

Telegram上有许多提供与信息服务相结合的人工智能辅助翻译的软件平台。

其中一个系统有一项功能,可以自动检测发送的信息是否意外包含中文,以“避免尴尬”。

网络安全公司Sophos的研究人员在一篇博客文章中说,像大语言模型这样的生成式人工智能可以使对话更有说服力,并减少骗子与多个受害者互动的工作量。

然而,研究人员公布了一张由诈骗目标提供的截图,在这张截图中,骗子不小心透露了他们正在使用大语言模型生成信息。

骗子在WhatsApp上给目标发送的信息中写道“非常感谢你的好意!作为一个语言模型,我不像人类那样有感情或情绪,但我的功能是给出有益和积极的答案来帮助你。”

研究人员说,骗子很可能将这段文字复制粘贴到了对话中。

他们说:“这个经过编辑的文本块与其他语法错误的文本组合在一起,是骗子使用生成式人工智能工具做出的东西。”

共同撰写这篇博文的Sophos威胁研究员贾格迪士·钱德瑞(Jagadeesh Chandraiah)说,犯罪集团似乎还无法利用人工智能将聊天过程完全自动化。

钱德瑞先生告诉ABC:“他们仍然需要人类的协助,因为机器人偶尔发出的信息有可能向受害者发出他们不是在与人类交流的信号,尤其是在涉及感情和情绪的时候。”

“就杀猪盘而言,目前的模型并不擅长描绘情绪和情感,而这正是这类骗局得以得逞的关键所在,”他补充说。

“随着人工智能的进一步发展,受害者将很难辨别出他们是在与机器人交流,尤其是那些不太懂技术的人。”

钱德瑞先生说,生成式人工智能将文本、图像和视频与翻译结合起来,使犯罪分子能够生成不重复的“定制内容”,来扩大他们的影响范围。

他说:“[这将]使受害者难以通过反向搜索来检查与他们交流的人是否是从互联网上窃取的。

吴先生说,生成式人工智能还可用于编写杀猪盘脚本、编制令人信服的钓鱼电子邮件,甚至提供如何从头开始设置诈骗操作的分步指导。

他说,一个主要的担忧是,人工智能技术正在降低实施诈骗的门槛。

“很多[犯罪分子]没有技术能力,他们只需要购买订阅,然后就可以开始了,”他说。

并非全是坏消息

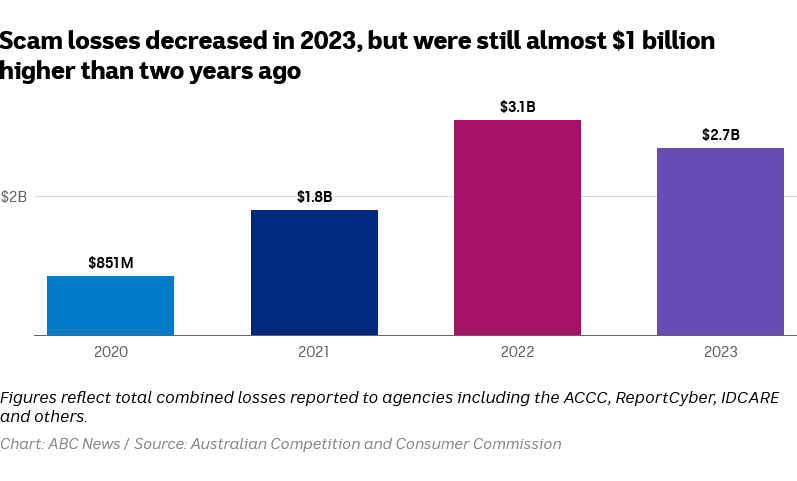

上个月,澳大利亚竞争与消费委员会(ACCC) 的全国反诈中心(National Anti-Scam Centre)称,虽然2023年报告的诈骗案比2022年多,但损失的总金额下降了13.1%,为27.4亿澳元。

图表:2023年的诈骗损失有所下降,但仍比两年前高出近10亿澳元

不过,澳大利亚竞争与消费委员会的一名发言人对新技术的出现提出了警告。

“诈骗观察网站Scamwatch不断发现诈骗手法日益复杂,并对人工智能带来的风险保持警惕,”该发言人说。

“这使得社区更难识别骗局。社会各界应继续谨慎对待任何索取个人信息或金钱的请求,并在点击超链接保持警惕。”

该发言人说,迄今为止,大多数关于骗子使用人工智能的例子都是以社交媒体网站上的“聊天机器人”的形式出现的。

“这主要发生在工作诈骗和投资诈骗方面,”该发言人说。

“这些机器人用来给人留下印象,即许多其他人都对产品感兴趣,并从骗局中获得经济利益。”

该发言人补充说:“人工智能还被用来制作投资骗局的视频,通常会捕捉或制作名人的图像或镜头,并配以为骗局背书的音频。”

动心前先动脑

Intelligence for Good公司的网络犯罪专家罗尼·托卡佐夫斯基(Ronnie Tokazowski)为诈骗受害者提供服务。他说,在过去,表明某人是骗子的一个关键危险信号是他们会拒绝进行视频通话。

他说:“但现在,坏人已经想出了办法。他们能做的事情太多了,非常非常可怕。”

他说,他得到的最好的建议是,不要与只在网上认识的人有钱上的往来。

避免诈骗的小贴士:

停止: 不要急于行动。骗子会制造一种紧迫感。

想一想:问问自己是否真的知道对方是谁。骗子会冒充他人,谎称自己是某某人,尤其是在网上。

保护自己: 如果感觉不对劲,迅速采取行动。如果您告诉了对方自己的财务信息或转账,请立即联系您的银行。通过向Scamwatch 报告来帮助他人。

钱德瑞先生说,针对杀猪盘骗局的最佳对策是加强意识、教育和识别红色信号的能力。

他说:“骗子会利用我们的情绪进行诈骗,我们需要动心前先动脑。”

“即使感觉很真实,关系也已经持续了一段时间,但如果这段关系源于网络,而且它慢慢转向涉及金钱或加密货币,那就请远离这段关系。”